Predice el precio de cualquier casa | Machine Learning idealista | Python | Inteligencia artificial

Вставка

- Опубліковано 25 вер 2022

- CURSO DE INTRODUCCIÓN A PYTHON: javidatascience.com/producto/...

Página web: javidatascience.com/

javidatascience.substack.com/

Es mi newsletter en la que envío correitos cada dos semanas hablando sobre programación, data science, data engineering y mundo empresarial.

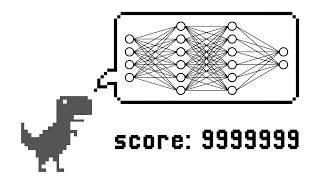

En este video te enseño a crear una inteligencia artificial que predice el precio de las casas gracias a los datos de idealista.

Está hecho en python y he usado web scrapping, técnicas de data engineering, análisis de datos y machine learning.

Escríbeme con cualquier duda que tengas.

Un saludo!

Data science en español.

Correo: javidatascience@gmail.com - Наука та технологія

Javi, aquí economista y con máster en Data Science. No puedo explicarte lo agradecido que estoy por tan excelente tutorial , mejor que todos los profesores vende humo.

Estaré atento a todo lo que vayas subiendo, así como tú blog.

Muchas gracias por el aporte!

Muchas gracias por tus palabras! Un placer!

Muchas gracias, súper interesante!

Hola, muchas gracias por lo que nos compartes en tus videos. Me gustaría un video de Web Scrapping. Muchas gracias.

Gracias a ti Kenny! Tienes un video de webscrapping en mi canal, seguro que te gusta!

Buenas,Javi

Estas hecho un crack, espero que sigas sacando videos por que lo valen muchísimo, con mucho gusto voy a copiar tu IA ya que yo también estoy buscando casa para comprar, en lugar de scrapear la información voy a consultar la API del idealista usando spark para almacenar la información.

un saludo

Buenas!

Muchas gracias por tus palabras. Encantado de que uses mi IA. Cualquier duda, estaré deseoso de ayudar!

Pronto voy a subir algunos videos mas analizando más este tema, estoy seguro de que te gustarán.

Un abrazo!

Buenisimo video

Gracias!!

Excelente vídeo y contenido.

Visto en 02/03/2024

Muchas gracias!!

Grande Javi, me he suscripto. Aficionado total. Qué guías recomiendas para empezar a tener nociones básicas de Data Science aplicables en poco tiempo? Saludos desde BCN, un argentino.

Gracias por las palabras Nico!

Aquí te dejo una breve guia:

1. Python y SQL

2. Estadística

3. Data processing

4. Machine learning

5. Cloud y puesta en producción (versión pro)

Un saludo!!

Dónde podemos ver cómo hiciste el scrapping? Gracias!

Está en uno de los siguientes vídeos!

Hola Javi que tal? Podrias hacer el video que comentas al principio del video de web scaroping y analisi de los datos. La verdad que lo estuve intentado con la API de idealista pero no es facil de usar.. .

Buenas Fernando!

Claro, lo tengo en mi lista de videos pendientes. Estoy editando uno en estos momentos, y, ya que me lo has pedido, el siguiente será sobre cómo extraer estos datos.

Un saludo!

@@javidatascience Perfecto Javi! Sobeetodo es que yo al intentar extraerlos ya sea por la API que tienen o haciendo web scrapping me bloquearon la IP y ni con proxies, ni VPNs ni cambiando el User-Agent consegui que me dejaran

Un saludo y mil gracias por responder!

Hola Javi! Super top el vídeo, muchísimas gracias. Vengo del mundo del marketing y conozco algo de código pero aún con python no he trabajado, pero al abrir el archico en Jupyter me da algunos errores, ¿Sabes a qué puede deberse? El último que no he podido solucionar es browser = uc.Chrome()

Otra duda, estoy pensando en automatizar un sistema que realizo de manera manual, es guardar las casas que se alquilan que cumplen x criterio en idealista, con sus valores y luego saber si se han dado de baja en idealista (por lo que seguramente se han alquilado) y la fecha. ¿Crees que es posible automatizar esto? Que corra con algún cron de manera diaria?

Hola Francis! Muchas gracias!

Usar este navegador no es sencillo, pero tampoco imposible. Busca el chromedriver que te pide y descárgalo (si ese es el error). Este es de los errores más comunes.

Luego, para lo que preguntas, creo que es difícil usar un cron, porque casi siempre vas a tener que hacer una acción para que comprueben que no eres un robot. Pero si lo lanzas manualmente cada día, creo que sería posible sí! Así es como lo enfocaría yo.

Genial Javi... Gracias por tu aporte 👍 algún contacto para consulta privada

Gracias a ti Juan!

Claro, escríbeme al correo: javidatascience@gmail.com

Un saludo!

Se puede hacer el google colab? o solo es en jupyter? gracias por el video por cierto !

Gracias a ti! Pues en Google colab, selenium siempre da problemas. Yo prefiero hacerlo en jupyter o en un .py

se puede estimar los precios con algún método del aprendizaje no supervisado?

Buena pregunta.

Respuesta corta: No.

Respuesta larga: se me ocurre que podemos analizar diversos clusters con las variables de las casas y dividir en casas con precio alto, medio y bajo. Pero claro, tenemos la información de los precios de antemano, que nos facilita llegar a esta conclusión.

Tengo un proyecto en el que analizo varios clusters sobre la segmentación de zonas de un país, sería interesante traerlo.

Gracias por la pregunta!

Es posible teber acceso a la base y el código?

La parte de web scrapping la puedes conseguir uniéndote a mi newsletter, que está en la descripción de los vídeos.

El código completo está en venta privada para algunos masters y algunos clientes concretos.

Si quieres, prueba la parte de web scrapping y, si estás interesado en todo el código, escríbeme al correo sin compromiso y hablamos mejor: javidatascience@gmail.com

Oye, a mí me acaba de funcionar el código... He puesto más retardo y me ha sacado 350 pisos de idealista de un barrio entero

Que bien!!

me bloquean cada vez que quiero data scrape el sitio, sabes como evitar eso ? gracias!

Prueba a meterle tiempo de espera. Mejor que la espera sea alta y funcione a que quieras ganar 10 minutos y te falle.

Hola Javier,

Salta justo en el data frame de la predicción.

df_pred = pd.DataFrame(y_pred) pero al hacer el merge da error KeyError: 'joinear', la verdad, que he hecho un añadir columna con los valores esos, pero supongo que no es la manera correcta.

Hay algo que me esté comiendo para que me dé el error al hacer el merge?

Gracias,

Bien visto! Te dejo por aquí esta parte, dime si te funciona!

df_preds = pd.DataFrame(pd.Series(y_pred, name = 'precio_pred'))

df_preds.index = df_preds.index.set_names(['joinear'])

df_preds = df_preds.reset_index()

df_preds

@@javidatascience muchas gracias, me sigue dando error el “joinear” pero lo he solucionado diciendo con que hacer el join directamente, así que ya está.

Muchas gracias.

@@DanielRamos-ze2mh Genial Daniel! Una pregunta, has podido sacar los datos de la pagina sin problema?

@@javidatascience si, le he metido al código una condición para que vaya alternando proxies y así evitar el bloqueo.

@@DanielRamos-ze2mh Que bueno! Te puedo pedir que me lo envíes al correo para verlo? javidatascience@gmail.com :D